NeurIPS,全称神经信息处理系统大会,是机器学习方向国际上公认的三大顶级会议之一,代表着当今人工智能研究的最高水平。同时,该会议在中国计算机学会国际学术会议排名中为人工智能领域的A类会议。

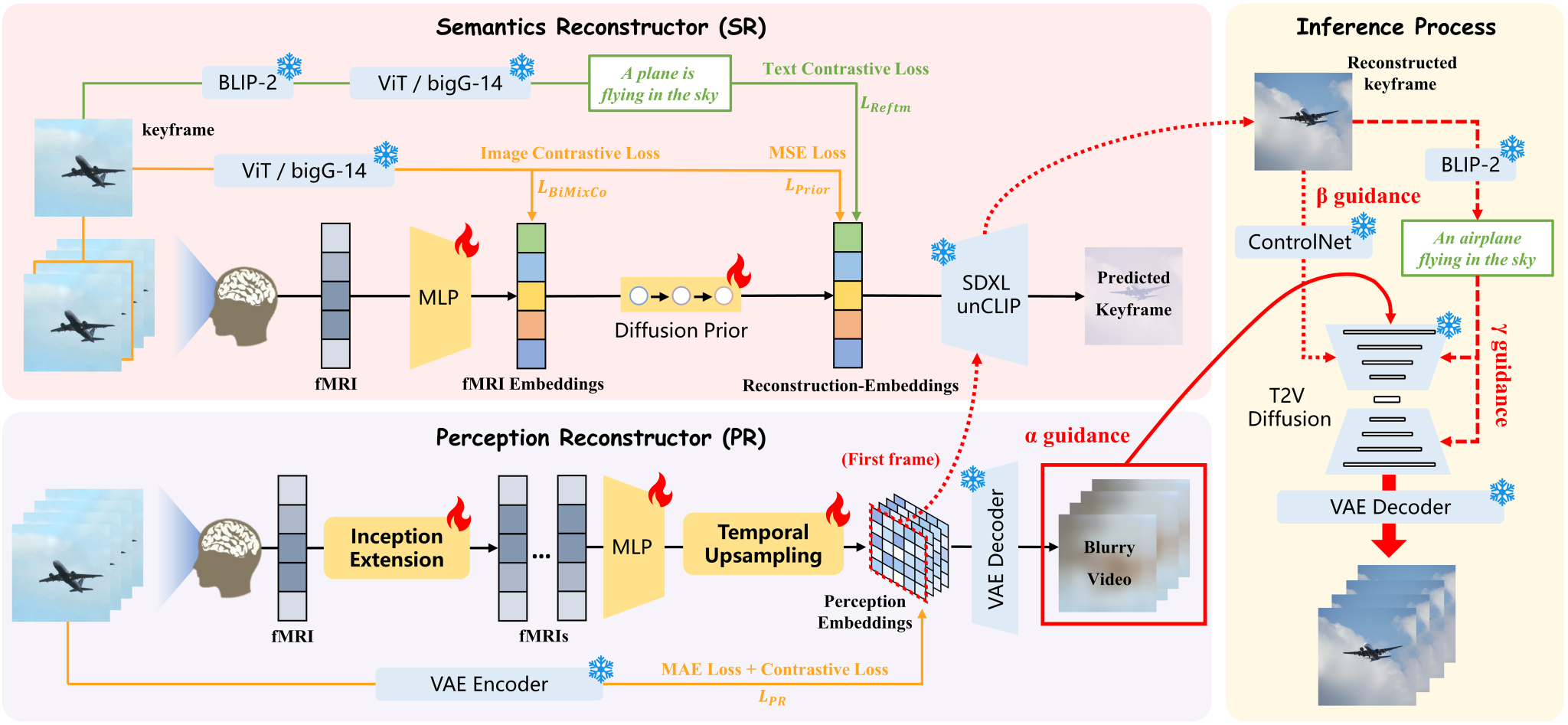

从大脑信号还原视觉刺激一直是神经科学和计算机科学研究人员们津津乐道的话题。得益于如CLIP和Stable Diffusion等先进的深度学习模型,基于非侵入式大脑活动fMRI(功能性磁共振成像)对静态视觉刺激的重建已取得显著成功。然而,fMRI到视频的重建研究仍然有限,因为解码连续视觉刺激的时空感知是一项艰巨的挑战。为此,本文提出了一种名为NeuroClips的创新框架,用于从fMRI数据中解码高保真和流畅的视频。NeuroClips使用语义重建器来重建视频关键帧,以保证语义的准确性和一致性,并利用感知重建器捕获低级感知细节,确保视频的平滑度。在推理阶段,则采用一个预训练的T2V扩散模型,同时注入关键帧和低级感知流进行视频重建。此外本文还设计了多fMRI帧融合,以此来重建更长的视频。该模型不仅在各项指标上实现了SOTA性能,还通过使用多fMRI融合,开创了长达6秒、8帧率视频重建的探索。